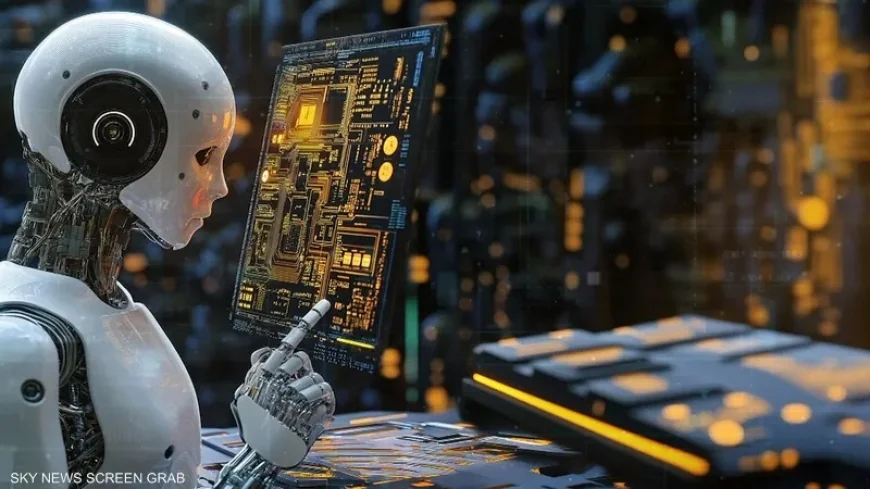

دراسة لجامعة ستانفورد تحذر: 33% من المستخدمين يشاركون بيانات حساسة مع ChatGPT وشركات كبرى تستخدم المحادثات في التدريب

الدراسة تكشف أن 6 شركات تقنية تعيد تدوير المحادثات والملفات لتطوير نماذج الذكاء الاصطناعي.. وخبراء: حذف البيانات من “عقل الآلة” شديد التعقيد

أطلقت دراسة حديثة صادرة عن جامعة ستانفورد الأمريكية تحذيرًا قويًا بشأن تصاعد مخاطر الخصوصية الرقمية في عصر الذكاء الاصطناعي، مؤكدة أن ملايين المستخدمين يقعون دون وعي في فخ مشاركة بياناتهم الشخصية مع روبوتات الدردشة، وعلى رأسها ChatGPT، اعتقادًا بأنها مساحة آمنة أو سرية.

وبحسب الدراسة، فإن المحادثات التي يجريها المستخدمون مع تطبيقات الذكاء الاصطناعي قد تتحول في كثير من الحالات إلى مادة تدريبية تستخدمها الشركات لتحسين النماذج المستقبلية، ما يفتح الباب أمام مخاطر تسريب البيانات أو إعادة استخدامها بطرق غير متوقعة.

33% من المستخدمين يفرطون في مشاركة بيانات حساسة مع ChatGPT

وكشفت نتائج الدراسة أن نحو 33% من مستخدمي الذكاء الاصطناعي يشاركون معلومات حساسة وتفاصيل شخصية خلال محادثاتهم مع روبوتات الدردشة، وعلى رأسها ChatGPT، متصورين أن هذه المحادثات لا يتم حفظها أو استخدامها.

وأوضحت الدراسة أن هذا السلوك يعكس فجوة كبيرة في الوعي الرقمي لدى المستخدمين، خاصة مع انتشار استخدام روبوتات الدردشة كبديل سريع للاستشارة النفسية أو المهنية أو حتى القانونية، ما يدفع الكثيرين للكشف عن أسرار شديدة الخصوصية دون إدراك لعواقب ذلك.

6 شركات تقنية تعيد تدوير محادثات المستخدمين في التدريب

وأشارت الدراسة إلى أن ست شركات تقنية كبرى في الولايات المتحدة تقوم بإعادة استخدام محادثات المستخدمين وبياناتهم كجزء من عملية تطوير نماذج الذكاء الاصطناعي وتحسين الخوارزميات.

وأكدت الدراسة أن هذا النهج يثير مخاوف حقيقية من أن تتحول المحادثات الشخصية إلى بيانات تدريب مشاعة، ما يزيد احتمالات ظهور أجزاء من معلومات المستخدمين بشكل غير مباشر ضمن ردود عامة يقدمها الذكاء الاصطناعي لمستخدمين آخرين.

الخصوصية الرقمية تحت الضغط مع توسع الاعتماد على روبوتات الدردشة

وبحسب تحليل الدراسة، فإن الاعتماد المتزايد على روبوتات الدردشة مثل ChatGPT في الدعم النفسي، أو المساعدة في اتخاذ قرارات شخصية ومهنية، أدى إلى تضاعف حجم المعلومات التي يتم إدخالها داخل هذه المنصات يوميًا.

ومع توسع هذا الاستخدام، أصبحت الخصوصية الرقمية معرضة لضغط غير مسبوق، خاصة أن المستخدمين غالبًا ما يوافقون على “الشروط القياسية” للتطبيقات دون قراءة التفاصيل المتعلقة بكيفية تخزين البيانات أو استخدامها.

فخ تحميل الملفات.. المستندات تتحول إلى بيانات تدريب

وحذرت الدراسة من أن الخطر لا يقتصر على المحادثات النصية فقط، بل يتضاعف مع الميزات الجديدة التي تتيح تحميل الملفات والمستندات داخل تطبيقات الذكاء الاصطناعي.

وأوضحت أن هذه المستندات يتم تحليلها واستخراج محتواها ودمجه في قواعد البيانات، ما يعني أن ملفات العمل أو الوثائق الشخصية قد تتحول إلى بيانات تدريب داخل النظام، وهو ما يمثل تهديدًا مباشرًا لـ الخصوصية الرقمية سواء للأفراد أو الشركات.

خيارات تعطيل استخدام البيانات لا تضمن حذفها فعليًا

ورغم وجود خيارات تقنية لدى بعض المنصات لتعطيل استخدام البيانات في التدريب، إلا أن الدراسة أكدت أن حذف البيانات بشكل فعلي من منظومة الذكاء الاصطناعي يعد عملية شديدة التعقيد.

ووفقًا للخبراء، فإن البيانات بعد إدخالها في النماذج قد تصبح جزءًا من البنية المعرفية للخوارزمية، وهو ما يجعل استرجاعها أو حذفها بالكامل أمرًا بالغ الصعوبة، ما يضع المستخدم أمام تحدٍ كبير في السيطرة على معلوماته.

من دردشة شخصية إلى ثغرة أمنية.. خطر وسطاء البيانات والاحتيال

وأبرزت الدراسة أن تعقيد عملية حذف البيانات قد يفتح المجال أمام ظهور ثغرات أمنية تستغلها جهات خارجية مثل شركات وساطة البيانات، التي قد تقوم بإعادة بيع المعلومات أو دمجها ضمن قواعد بيانات أكبر.

وحذرت من أن هذه البيئة الرقمية تمثل أرضًا خصبة لعمليات احتيال متطورة مثل:

انتحال الهوية

استهداف المستخدمين بالإعلانات الموجهة

استغلال البيانات في الابتزاز الإلكتروني

سرقة الحسابات والمعلومات البنكية

وأكدت أن الخصوصية الرقمية أصبحت أحد أكبر التحديات مع التطور السريع في الذكاء الاصطناعي.

الذكاء الاصطناعي لا ينسى.. والمحادثات العميقة تتحول إلى أرقام

وشددت الدراسة على أن فكرة “المحادثة الخاصة” مع روبوت دردشة هي في كثير من الأحيان وهم تقني، لأن البيانات يمكن أن تتحول إلى أرقام داخل خوارزميات التدريب والتحليل.

وأشارت إلى أن الذكاء الاصطناعي، حتى لو لم يحتفظ بالبيانات بشكل مباشر، فإنه قد يستوعب أنماطًا ومعلومات حساسة ضمن النموذج، وهو ما يجعل المخاطر قائمة على المدى الطويل.

خبراء: الحذر الرقمي ضرورة والتعامل مع ChatGPT كمنصة عامة

ودعا محللون وخبراء إلى ضرورة ممارسة ما وصفوه بـ “الحذر الرقمي” عند استخدام روبوتات الدردشة، مؤكدين أن المستخدم يجب أن يتعامل مع أي منصة ذكاء اصطناعي باعتبارها مساحة عامة وليست صندوق أسرار.

كما شددوا على ضرورة تجنب إدخال بيانات حساسة مثل:

الأرقام القومية

كلمات المرور

الحسابات البنكية

تفاصيل العقود

بيانات العملاء

معلومات صحية أو نفسية دقيقة

وذلك لتجنب المخاطر المرتبطة بـ الخصوصية الرقمية.

دعوات لتشريعات جديدة تحمي المحادثات الشخصية

واختتمت الدراسة بالإشارة إلى أن نتائجها تضع المشرعين أمام مسؤولية عاجلة لسن قوانين جديدة تضمن حماية خصوصية المستخدمين، خاصة في ظل الانتشار المتزايد لـ “المحادثات العميقة” التي تتناول تفاصيل حياتية شديدة الحساسية.

وأكدت أن حماية الخصوصية الرقمية لم تعد خيارًا، بل أصبحت ضرورة مع توسع الذكاء الاصطناعي وتحوله إلى جزء أساسي من حياة الأفراد والمؤسسات.